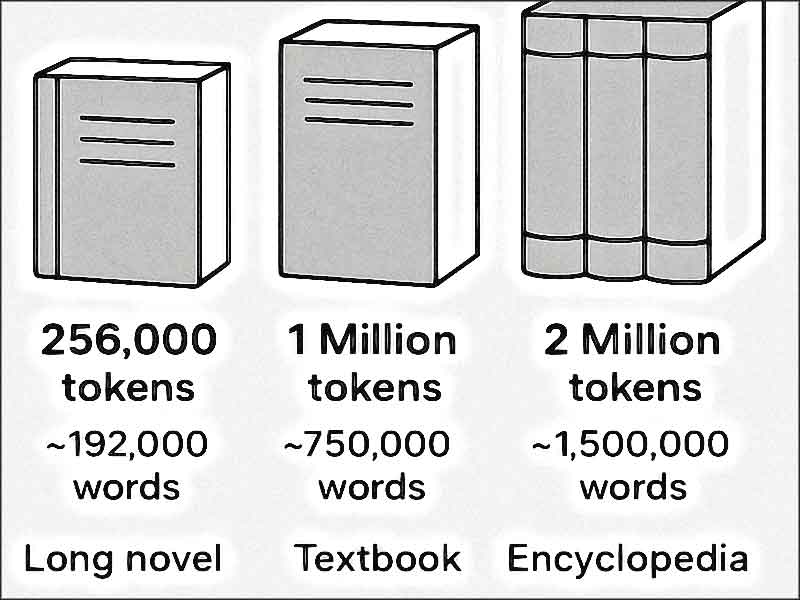

La fenêtre d’1 million de tokens est bien pire que ce que la plupart imaginent. Thariq, l’ingénieur de Claude Code, l’explique.

La dégradation commence avant la moitié de la fenêtre. La compaction aggrave généralement les choses.

Claude Code dégrade ses performances bien avant d’atteindre le million de tokens promis. La pourriture du contexte commence autour de 300 000 à 400 000 tokens, soit environ 40 % de la fenêtre.

- Le modèle hallucine davantage

- oublie les instructions données plus tôt

- et prend de mauvaises décisions.

La compaction automatique aggrave souvent la situation en supprimant des informations cruciales. Pour y remédier, il faut déclencher manuellement la compaction, utiliser la commande clear entre les tâches, et adopter une structure JSON pour préserver les informations importantes. Les sous-agents aident aussi à isoler le contexte.

Claude Code semble dégradé alors que les modèles sont puissants. Il hallucine davantage, oublie les instructions données plus tôt.

Les modèles après OPUS 4.5 ont une fenêtre d’1 million de tokens au lieu de 200 000. C’est une arme à double tranchant.

La pourriture du contexte signifie que les performances se dégradent avec plus d’informations. Avec un million de tokens, le contexte devient chargé et interfère avec le raisonnement.

Selon le créateur de Claude Code, la pourriture du contexte commence autour de 300 à 400 000 tokens, soit environ 40 % d’utilisation.

Les quatre modes d’échec de votre agent

Thariq détaille quatre façons dont votre agent peut échouer.

- La première, c’est la pollution du contexte. Trop d’informations parasites noient les données utiles.

- Dérive des objectifs. L’agent s’écarte de ce qu’il doit faire.

- La corruption de la mémoire est un autre problème. L’état interne devient incorrect. Par exemple, un fichier modifié par un sous-agent, l’agent se réfère à sa mémoire obsolète.

- L’inexactitude des décisions aussi. Le modèle fait des choix contradictoires dans des situations similaires.

La pollution du contexte en détail

Quand la fenêtre se remplit, le modèle perd en précision. Il mélange les priorités. Les instructions les plus récentes prennent le dessus sur les consignes initiales. C’est le biais de récence.

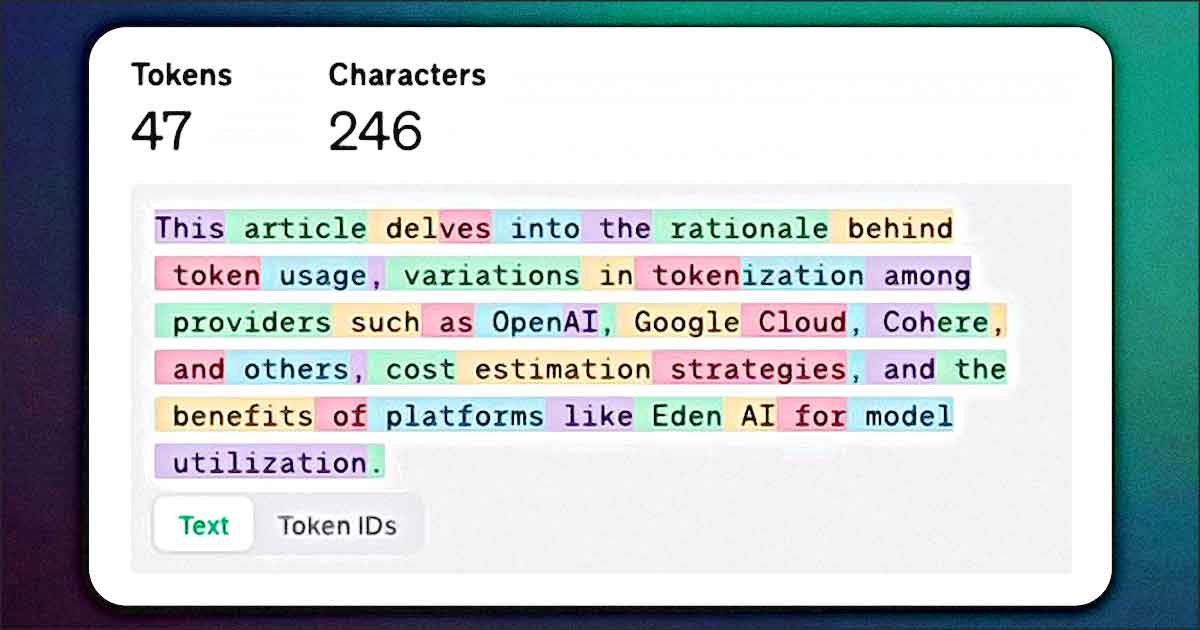

⇒ Sur notre blog : Glossaire ia, llm, tokens, prompt, outils et agents expliqués

La dérive des objectifs, un piège classique

L’agent commence une tâche de débogage. Après quelques échanges, il se met à réécrire du code. Il oublie la mission initiale. Le contexte chargé le fait dévier.

Compaction automatique et biais de récence

Une fois que Claude a terminé, cinq options existent pour la prochaine instruction. Le choix le plus naturel est de continuer, mais les autres aident à gérer le contexte.

La compaction est une synthèse du contenu. Le résumé est avec perte. Il est préférable de contrôler vous-même la compaction plutôt que de laisser Claude l’auto-déclencher.

Je mets à jour ou crée vos articles personnellement, assisté par l'IA, avec optimisation SEO incluse.

| 📝 Mise à jour | 14 € |

| ✨ Création | 49 € |

Claude est le moins fiable lors de la compaction. Son attention est uniquement sur la synthèse, privé du contexte d’assistance. Il se fie à ses propres hypothèses.

Exemple : session de débogage, un avertissement rencontré plus tôt est supprimé après compaction automatique. Le modèle ne sait pas de quel avertissement vous parlez.

Le biais de récence aggrave la situation. La compaction donne la priorité aux détails récents. Les informations plus anciennes mais importantes sont ignorées.

Quand et comment déclencher la compaction

⇒ Déclenchez la compaction autour de 300 000 à 400 000 tokens. Fournissez une instruction de compaction : dites-lui quelles décisions, contraintes et problèmes doivent être reportés.

La commande « clear » supprime tout le contexte. Utilisez-la pour une tâche sans rapport. Exemple : écrire des cas de test, puis passer au débogage dans une nouvelle session.

Les bonnes pratiques pour gérer le contexte

Une approche combine « clear » et compaction. Utilisez un format JSON structuré pour capturer les informations à préserver. Créez une commande personnalisée.

Exemple de structure JSON : tâche complète, état actuel, contraintes, problèmes découverts. Sauvegardez dans un fichier. Utilisez « clear » pour tout supprimer. Démarrez une nouvelle session en vous référant à ce document.

La technique du récapitulatif périodique

Faites une pause périodiquement. Demandez à l’agent de récapituler ce qu’il a fait. Cela renforce les objectifs originaux et ramène les détails clés dans la partie récente de la fenêtre.

L’utilisation stratégique des sous-agents

Les sous-agents sont importants pour gérer le contexte. Chaque sous-agent a sa propre fenêtre de contexte. Il exécute le travail et ne renvoie que le résultat final. Les appels d’outils, fichiers lus, raisonnement intermédiaire restent dans son propre contexte.

Exemple : tâches de recherche. Un sous-agent parcourt plusieurs sites et ne renvoie que la synthèse finale.

Gestion du contexte en équipe et limites pratiques

Les plans Team nécessitent un minimum de cinq membres et ne sont pas destinés à un usage individuel. Si vous avez déjà un compte Claude gratuit ou payant associé à votre e-mail professionnel et que vous souhaitez créer un plan Team, vous devrez peut-être ajuster votre approche de gestion du contexte.

⇒ Sur notre blog : Réduire les tokens Claude Code, astuces et réglages cachés

La question clé : aurez-vous besoin d’accéder aux étapes intermédiaires ou seul le résultat final compte

Le retour en arrière supprime les parties non pertinentes ou incorrectes de la fenêtre de contexte. Utilisez la commande de retour en arrière ou appuyez deux fois sur Échap. Résumez à partir de ce point.

Avantages : nettoie la fenêtre, donne un résumé de compaction plus propre, évite de transporter des sections où l’agent s’est écarté de l’objectif. Les sous-agents reçoivent un contexte plus propre.

Prenez l’habitude de revenir en arrière plutôt que de corriger continuellement vers l’avant.

Les trois techniques à retenir

- Déclencher la compaction manuellement vers 300 000 tokens avec une instruction précise

- Utiliser la commande clear entre des tâches sans rapport pour repartir de zéro

- Structurer les infos clés en JSON avant de nettoyer le contexte

Les erreurs à éviter absolument

- Laisser la compaction automatique s’activer sans supervision

- Accumuler du contexte inutile sans faire de pause récapitulative

- Ignorer le biais de récence qui favorise les informations récentes

Sans dec, la prochaine fois que votre agent Claude semble perdre la tête, pensez à la pourriture du contexte. Un bon nettoyage manuel vaut mieux qu’une compaction automatique hasardeuse.

⇒ Sur notre blog : Skill caveman sur Claude et Opencode, réduire ses tokens de 75 %