Il existe un appelé plugin MCP appelé Claude Context qui indexe l’intégralité de votre base de code dans une base de données vectorielle, ce qui signifie que votre agent de codage peut obtenir rapidement le code exact dont il a besoin sans deviner en utilisant grep ou glob et en espérant qu’il trouve le bon fichier.

Il transmet même votre code avec des AST et utilise une approche de recherche hybride combinant des vecteurs sémantiques avec une correspondance de mots clés, ce qui finit par utiliser 40 % de contexte en moins.

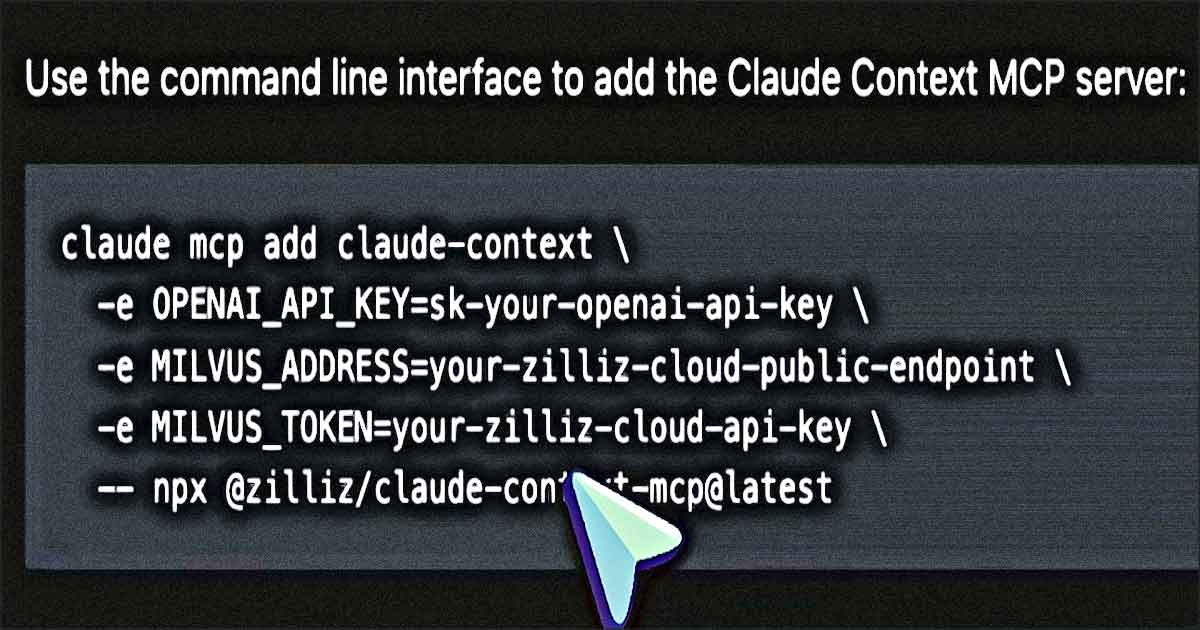

Il a besoin d’un compte Zilliz Cloud et d’une clé OpenAI pour les intégrations même si vous utilisez Claude Code.

L’effort et le coût supplémentaires valent-ils les économies symboliques ?

Claude Context : le contexte intelligent pour ton code

Le problème

Sans contexte ciblé, Claude reçoit trop de code : tokens explosés, réponses diluées, coûts inutiles.

La solution

Claude Context indexe ton codebase via Milvus/Zilliz. Recherche hybride BM25 + embeddings : seul le contexte pertinent atteint Claude.

Les bénéfices

- Réduction des tokens envoyés à l’IA

- Réponses plus précises et contextuelles

- Compatible MCP (Model Context Protocol)

- Codebase entier exploitable sans surcoût

Milvus / Zilliz

Hybrid Search

⇒ Testez Uncensored, le llm sans filtre ni censure (lien promotionnel affilié)

Claude Context, réalisé par Zilliz qui est une société créée par les fondateurs de Milvus, possède une base de données vectorielles très performante. Il se connecte à votre agent par MCP, ce qui signifie qu’il peut fonctionner avec n’importe quel agent et pas seulement avec Claude Code.

Il effectue 3 choses assez complexes pour rendre votre code facilement trouvable.

- Premièrement, il utilise Tree-sitter pour parcourir tout le code créant des morceaux de fonctions et de classes, et cela prend en charge neuf langages, dont TypeScript, Python, Rust et Go.

- Ensuite, il utilise un DAG Merkle personnalisé pour hacher chaque fichier avec des instantanés JSON, ce qui signifie qu’il réindexe uniquement les fichiers qui ont changé et non l’intégralité de la base de code.

- Et puis, lorsque vous souhaitez réellement effectuer une recherche dans le code, il effectue deux types de recherches différents en même temps.

Recherche vectorielle + BM25 : le meilleur des deux mondes

Le plugin combine 2 approches :

- la recherche vectorielle pour capter le sens du code,

- et l’index BM25 pour les correspondances exactes de mots-clés.

Résultat ? Jusqu’à 40 % de contexte en moins envoyé à l’IA. Sur un gros projet, ça change tout.

J’ai voulu tester ça en conditions réelles. Direction le repo VS Code : environ 1,5 million de lignes. Un beau morceau.

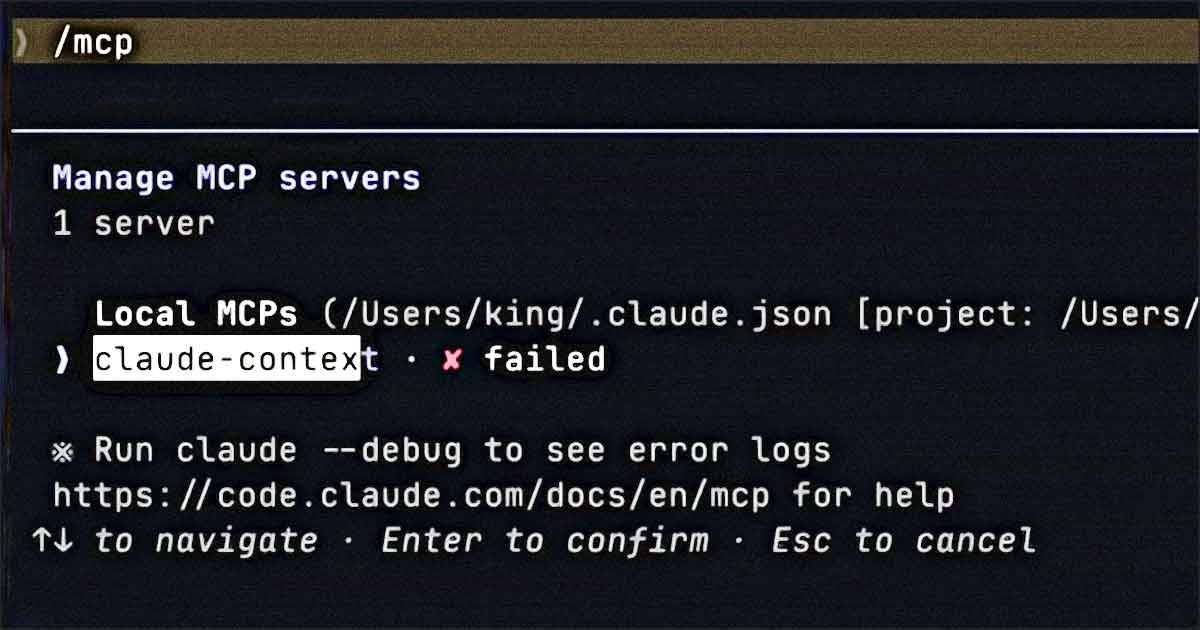

Pour ne pas exploser mon quota Claude Pro, j’ai utilisé Open Code avec GLM-4 Turbo. J’ai configuré le serveur MCP dans mon fichier JSON — rien de sorcier, mais il faut être méthodique.

Côté infrastructure : j’ai d’abord tenté Milvus en local. Spoiler : ça timeout tout le temps. J’ai donc basculé sur Zilliz Cloud (cluster AWS). Plus cher, mais ça tient la route.

Une fois le serveur MCP opérationnel, tu accèdes à quatre outils : index_code, search_code, clear_index et get_index_status. La première étape ? Lancer l’indexation.

J’ai vérifié ma conso OpenAI avant de me lancer : 0,01 $ pour un test sur 23k lignes. Rassurant. Puis j’ai lancé l’indexation du repo VS Code. Ça tourne en arrière-plan, et là, il faut patienter.

Après ~50 minutes, l’index est prêt : 223 000 entrées chargées. Pour comparer, mes 23k lignes de test ont pris moins d’une minute. Côté coût, on est passé de 0,01 $ à ~1,06 $. Cher, mais on parle d’une base énorme. Personne ne fait ça tous les jours.

Le test en conditions réelles

J’ai lancé deux instances en parallèle : une avec Claude Context MCP, l’autre sans. Même prompt : « Quelle fonction ouvre un nouveau document sans titre ? »

Résultats :

- Claude Context : 23 secondes, réponse précise avec extraits de code et fichiers liés

- Sans contexte : 49 secondes, même code mais sans la surrounding context

J’ai ensuite élargi la requête : « Explique-moi l’architecture de ce projet. »

Claude Context a terminé en 49 secondes (41k tokens). L’autre instance a été plus rapide et moins gourmande… mais la réponse était superficielle. Claude Context a détaillé l’architecture en couches, les processus Electron, les points d’entrée. L’autre ? Une vue d’ensemble correcte, mais sans profondeur.

J’ai poussé avec une question de suivi sur le main process Electron. Claude Context a mis ~1min47, mais le détail était bluffant : séquence de démarrage, initialisation des services, références fichiers précises (app.ts:185, etc.). L’instance sans contexte a mis ~5 minutes pour un résultat moins complet.

Oui, avec un modèle plus puissant type Opus et plus d’effort, on rattraperait peut-être le niveau. Mais au prix de quoi ? Temps + tokens. Le ratio de Claude Context reste imbattable sur ce cas d’usage.

Mon verdict (subjectif)

Sur des bases de code moyennes (20k-30k lignes), l’indexation est rapide et le gain en précision est net. Sur des monstres type VS Code, ça reste utile, mais le setup est plus lourd.

En tant que curieux qui fouille régulièrement des repos open source, je vais clairement réutiliser cet outil. Pour un projet perso ou une base de taille raisonnable, le plan serverless Zilliz + conso OpenAI reste abordable.