Transformer une simple photo en vidéo où votre personnage danse parfaitement le shuffle semblait impossible il y a peu. Aujourd’hui, grâce à Kling Motion Control 3.0, vous pouvez transférer n’importe quel mouvement complexe vers une image fixe avec une précision bluffante.

Aujourd’hui, nous allons apprendre à générer des vidéos dynamiques ou à nous transformer en personnages animés. Nous savons déjà tous générer une vidéo à partir d’une image ou d’un texte, mais comment faire en sorte que le personnage fasse exactement ce que nous voulons ?

La réponse est très simple : créer une vidéo à partir d’une autre vidéo.

Bonjour, c’est Des Geeks et des lettres, je m’appelle Grégory. Aujourd’hui, nous parlons de Kling Motion Control 3.0, un nouveau système qui transfère les mouvements les plus complexes d’une vidéo de référence vers des images pour leur donner vie. Il ne s’agit pas simplement d’animer une image mais d’avoir un contrôle total sur :

- le corps

- les mains

- les mouvements de caméra

- les expressions faciales

Un outil complet pour animer vos images

Vous pouvez trouver Motion Control sur le site Kling dans l’onglet Generate. En haut, sélectionnez Motion Control. Ce système prend une vidéo de référence, prend une image de référence et l’anime à l’aide des mouvements de cette vidéo.

Les principales fonctionnalités incluent les mouvements du corps entier, les mouvements des mains (en particulier des doigts), et la synchronisation des mouvements du visage, y compris les expressions faciales. Le tout est disponible en résolution 1080p pour un rendu professionnel.

Créons une vidéo de danse ensemble

Pour commencer, essayons de créer une vidéo de danse. J’ai trouvé sur YouTube la première vidéo venue qui enseigne la danse du shuffle, et je l’ai téléchargée. Ensuite, il faut :

- rembobiner la vidéo

- appuyer deux fois sur le bouton pause

- et enregistrer l’image car nous aurons besoin de la première image.

En gros, on peut s’en passer mais si l’on veut conserver une précision maximale des mouvements, il vaut mieux utiliser cette image. Que fait-on avec ? On ouvre n’importe quel logiciel d’édition d’images. Je vais utiliser NanoBanana.

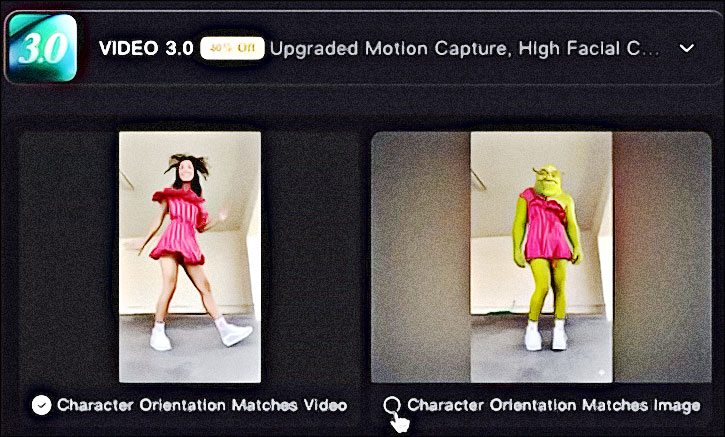

J’importe la première image et la photo du personnage à insérer. Nous écrivons la commande : « Remplacer la femme par Shrek ». Le remplacement s’effectue. La résolution s’est avérée médiocre, j’écrit : « Fais un upscaling, il y a beaucoup d’artefacts ». On obtient ainsi ce charmant Shrek.

Shrek ne correspond pas à la silhouette de l’image d’origine : sa tête est plus grosse, il a une moustache et ses mains sont plus grandes. À la place de Shrek, on aurait pu avoir un énorme chevalier en armure ou, au contraire, un nain. Mais cela n’a pas d’importance car le modèle conserve la structure du corps et la transpose sur la nouvelle image. C’est là toute la puissance de l’outil : il s’adapte à la morphologie du personnage que vous fournissez.

Les réglages essentiels pour un transfert réussi

Téléchargez la vidéo et l’image souhaitées. Lorsque la première image de la vidéo correspond parfaitement à l’image chargée, je recommande de sélectionner Character orientation matches Video. Ce mode transpose tous les mouvements avec beaucoup plus de précision.

Si nous voulons modifier l’angle de mouvement de la caméra ou s’il est important pour nous que la nouvelle vidéo diffère de l’originale sur d’autres paramètres que le personnage ou l’arrière-plan, il est préférable de sélectionner Character orientation matches Image. Il existe également une excellente fonction de reconnaissance faciale.

| Paramètre | Utilisation recommandée |

|---|---|

| Character orientation matches Video | Quand l’image correspond parfaitement à la première frame vidéo. Offre la meilleure précision de mouvement. |

| Character orientation matches Image | Pour changer l’angle de caméra ou si l’image diffère du premier plan vidéo. Plus de liberté créative. |

Préserver la stabilité du visage

Shrek est un personnage reconnaissable, il figure dans les ensembles de données, c’est pourquoi son visage est difficile à déformer. Si nous créons une vidéo avec notre propre personnage et qu’il est important qu’il reste similaire d’une génération à l’autre, nous avons besoin d’un visage stable.

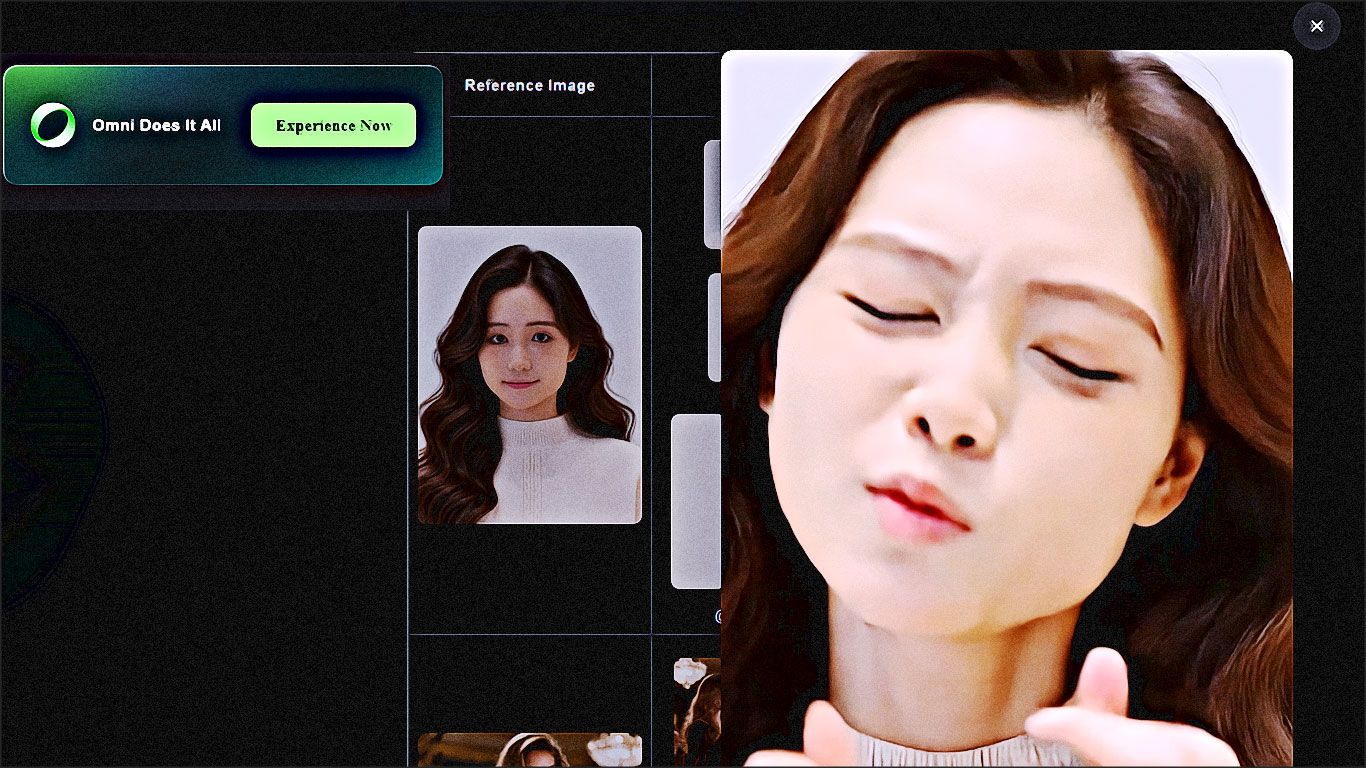

J’ai un personnage, une superbe jeune fille asiatique. Lors de notre stage intensif sur la vidéo IA, j’ai expliqué comment créer des matrices de personnages. C’est un excellent moyen de garantir la cohérence, afin que l’on sache toujours, d’une génération à l’autre, à quoi ressemble le personnage sous tous les angles.

Travailler avec un modèle de visage personnalisé

Je fais tout dans Freepik mais ce n’est pas obligatoire. Je télécharge simplement une image et je dis : « Remplace-la par cette femme ». Le résultat est plutôt bon. Ensuite on ajoute le visage. Kling propose une fonctionnalité remarquable, Elements, qui permet de créer la stabilité du visage.

On peut le faire à partir d’une vidéo de 3 à 8 secondes où vous tournez la tête et faites des mimiques, mais c’est superflu. Nous pouvons télécharger une image sous tous les angles. Nous avons choisi une jeune femme, nous l’avons téléchargée. Nous avons deux possibilités : télécharger 1 à 3 images supplémentaires ou les générer directement dans Kling en cliquant sur AI Multishot.

Cette fonction permet justement de préserver la stabilité du visage. Je vais télécharger mes images, car elles montrent le modèle sous différents angles. De plus, vous pouvez choisir une voix dans la bibliothèque ou télécharger la vôtre. Ensuite, on saisit un nom et on clique sur Generate.

Le résultat parle de lui-même : une superbe vidéo est générée. Remarquez bien que le visage ressemble à l’original. Contrairement à l’exemple avec Shrek, elle a même retouché ses cheveux, car Shrek n’en a pas.

Cette capacité à gérer les cheveux et les détails anatomiques prouve la sophistication du moteur de rendu.

Différence avec et sans référence

Dans ces exemples, Kling montre la différence : y a-t-il un élément de liaison lorsque nous fixons le visage, ou non ? Si le visage n’est pas visible sur l’image de référence, il s’affichera de manière incorrecte sur les images générées.

Avec la référence, on obtient une certaine qualité ; sans référence, c’est un visage complètement différent. De la même manière, j’ai essayé de recréer le célèbre mème. Avec la référence, ça ressemble ; sans, ce n’est plus vraiment ça.

Pourquoi le visage change-t-il sans image de référence ?

Le système ne dispose pas d’assez d’informations pour reconstruire un visage cohérent à partir d’un seul angle ou d’une image floue. La référence permet de « verrouiller » les traits caractéristiques du personnage.

Ajoutons des détails au prompt pour plus de réalisme

Parmi les problèmes rencontrés : sur les dernières vidéos, les flashs des appareils photo ne fonctionnaient pas, la foule était figée. C’est pourquoi il faut parfois compléter la prompt pour préciser ce que nous voulons voir en plus du transfert de mouvement.

J’ai ajouté : « L’homme se retourne, à l’arrière-plan, les paparazzi prennent des photos, les flashs des appareils photo crépitent ». Je n’avais pas besoin de mentionner le fait qu’il se retourne, le mouvement serait transféré de toute façon. Les flashs ont été ajoutés, même si parfois de travers, mais avec un peu de persévérance, ça finira par bien marcher.

Difficultés et solutions alternatives

En travaillant dessus, j’ai rencontré des problèmes. La deuxième moitié de la vidéo ne convient pas au Motion Transfer : le résultat est étrange. Si l’on choisit Character orientation matches Image, le résultat n’est pas du tout ce qu’il faut.

Je devais simplement remplacer le visage. J’ai utilisé une autre fonctionnalité : Kling Animo Model. Il y a eu une vidéo dédiée à cette fonctionnalité. En l’utilisant, on peut obtenir un résultat de qualité.

Comment j’ai changé la tenue du personnage

Ajout important : comment j’ai habillé la jeune fille en bikini. Vous risquez de rencontrer des problèmes avec ChatGPT ou Gemini, ils refuseront tout simplement à cause de la censure. Il faut un fournisseur tiers.

Pour le fun : NanoBanana (c’est-à-dire Gemini via l’API de Freepik) a accepté de tout faire, c’était génial. Grok s’en est également bien sorti, même s’il a changé l’angle de vue.

C’est Seedream qui s’en est le mieux sorti, le seul bémol étant que le visage a un peu déformé. J’ai téléchargé une image, indiqué le modèle de visage, et le résultat est magnifique. Sinon, pour une absence totale de censure et de filtre sur les IA, tournez-vous vous vers notre sponsor Uncensored.com.

Les limites actuelles du système

Tout d’abord, les prix

Kling propose des tarifs intéressants : à partir de 9 € par mois, ce qui permet de tester tranquillement le modèle. Mais si vous souhaitez créer une chaîne avec des vidéos quotidiennes, vous aurez besoin de la version Pro ou Premier.

La durée de la vidéo de base à télécharger est comprise entre 3 et 30 secondes. Si vous cliquez sur Character orientation matches Image, la durée est réduite à 10 secondes. Dans ce mode, il n’est pas encore possible d’utiliser le modèle de visage, mais la société promet que cela changera bientôt.

La vidéo ne doit pas comporter plus d’une personne. S’il y en a plus, le résultat est désastreux : chaque personne à l’arrière sera figée ou il faudra programmer ses mouvements. Pour l’instant, le modèle ne prend en charge que les mouvements d’une seule personne.

Ce qu’il faut garder en tête avant de se lancer

- Malgré ses performances, Kling Motion Control 3.0 a un coût : la version Pro devient vite indispensable pour un usage régulier…

- Durée des vidéos limitée

- Absence de prise en charge des groupes

- Fonction de stabilité du visaire pas encore compatible avec tous les modes

🛡️ À retenir : La sécurité en ligne est essentielle, ne naviguez pas sans protection. Découvrir ProtonVPN